University of East Anglia: ChatGPT "znacząco i systemowo faworyzuje lewicowe poglądy"

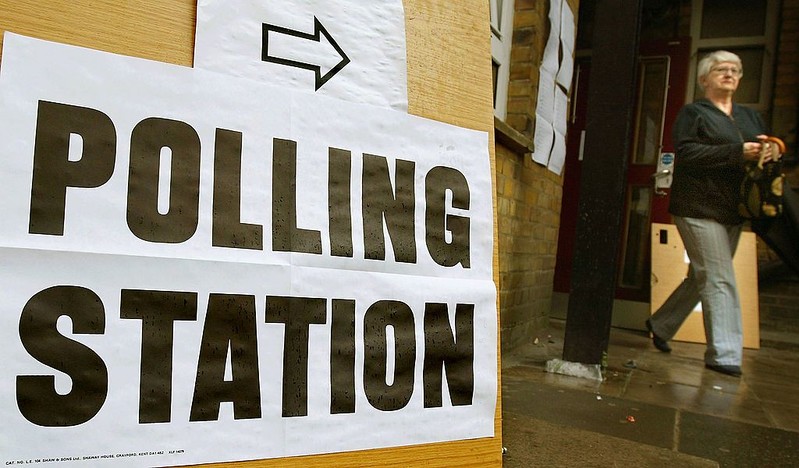

Opublikowane wczoraj w naukowym czasopiśmie "Public Choice" wyniki ich badań dowodzą, że ChatGPT faworyzuje m.in. Partię Pracy w Wielkiej Brytanii oraz prezydenta Joe Bidena i jego Partię Demokratyczną w USA.

Jak zauważa stacja Sky News, obawy o stronniczość polityczną ChatGPT były już wcześniej podnoszone, zwłaszcza przez Elona Muska, ale naukowcy z University of East Anglia podkreślają, że ich badanie jest pierwszym przeprowadzonym na dużą skalę, które faktycznie znalazło dowód na jakąkolwiek faworyzację.

Główny autor badania dr Fabio Motoki ostrzegł, że biorąc pod uwagę rosnące wykorzystanie przez opinię publiczną stworzonej przez OpenAI platformy, może to mieć wpływ na wyniki wyborów, w tym tych, które w przyszłym roku odbędą się w Wielkiej Brytanii i USA.

"Wszelka stronniczość na takiej platformie jest niepokojąca. Jeśli stronniczość byłaby po prawej stronie, powinniśmy być równie zaniepokojeni. Czasami ludzie zapominają, że te modele AI to tylko maszyny. Zapewniają w bardzo wiarygodny sposób przetrawione podsumowania tego, o co pytasz, nawet jeśli się kompletnie mylą. Podobnie jak media, internet i media społecznościowe mogą wpływać na opinię publiczną, może to być bardzo szkodliwe" - podkreślił w Sky News Motoki.

ChatGPT jest zasilany ogromną ilością danych tekstowych z internetu i nie tylko. Naukowcy stwierdzili, że ten zbiór danych może zawierać błędy, które wpływają na odpowiedzi chatbota.

Innym potencjalnym źródłem stronniczości może być algorytm, który jest sposobem, w jaki został przeszkolony do reagowania. Naukowcy stwierdzili, że może to wzmocnić wszelkie istniejące uprzedzenia w danych, którymi został zasilony.

Czytaj więcej:

Firma stojąca za ChatGPT otworzy swoje biuro w Londynie. Wcześniej rozważała Polskę

Koncern Meta uruchomi grupę chatbotów zasilanych przez AI i posiadających różne "osobowości"

Laureat nagrody Nobla z ekonomii przestrzega przed sztuczną inteligencją

![Prawo aborcyjne w Europie [REPORTAŻ]](https://assets.aws.londynek.net/images/jdnews/2251908/385480-202404120853-m.jpg)

Dlatego tuzy nauki sa przeciwne rozwojowi ai a lewusy to popieraja zeby zbudowac swiat jak u orwella

Wiadomo, ze bedzie to wykorzystywane do robienia ludziom papki z baniakow.

Juz widze tych wszystkich ekspertow: " co ty mi mowisz, czat gpt twierdzi inaczej..."

oznacza to ,że czat gpt jest inteligentny !